在网站运行过程中,服务器错误如同暗礁般潜藏于代码与配置的深水区,稍有不慎便会引发系统崩溃或用户体验滑坡。这类问题往往具备隐蔽性和突发性,但通过系统化的排查策略与工具辅助,开发者仍能快速定位病灶并实施精准修复。

错误日志深度解析

服务器日志是故障诊断的原始矿脉,Apache的error_log或Nginx的access日志中,隐藏着错误发生的时空坐标与行为轨迹。某次数据库连接超时案例显示,日志中连续出现的"Connection refused"提示,配合精确到毫秒的时间戳,最终定位到并发请求激增导致的连接池耗尽问题。专业的日志分析工具如ELK Stack(Elasticsearch, Logstash, Kibana),不仅能实现日志的实时聚合,还能通过模式识别自动标记异常事件,较传统文本检索效率提升70%以上。

日志分析的进阶策略包括建立错误指纹库,例如将"segmentation fault"类错误与内存泄漏特征绑定,将"Permission denied"与文件权限配置关联。某电商平台的运维团队通过机器学习模型,实现了对日志中500错误的自动分类,使平均故障响应时间从15分钟缩短至3分钟。

状态码语义破译

HTTP状态码是服务器与开发者对话的密码本,特别是5XX系列错误承载着关键诊断信息。当遭遇502 Bad Gateway时,这可能意味着上游服务器(如Tomcat或Node.js应用)未及时响应,某社交平台曾因此发现负载均衡器与后端服务的心跳检测间隔设置不合理。503 Service Unavailable常伴随CPU占用率突破90%的警报,某在线教育平台通过该状态码发现了未优化的视频转码算法导致的资源过载。

状态码的时空分布分析更具价值。运维人员发现某API接口的500错误集中发生在UTC时间凌晨三点,结合日志追溯发现这是定时任务与在线服务竞争数据库连接导致。通过Prometheus等监控工具建立状态码时序图,可直观识别错误爆发的周期规律。

资源监控体系构建

服务器的CPU、内存、磁盘IO等指标构成生命体征监测系统。某金融系统遭遇的间歇性宕机,最终通过Zabbix监控发现是内存泄漏导致OOM(Out Of Memory) killer进程强制终止关键服务。磁盘空间的监控更需要前瞻性,某云存储平台设置的85%容量预警线,成功避免因日志文件暴增引发的写入失败事故。

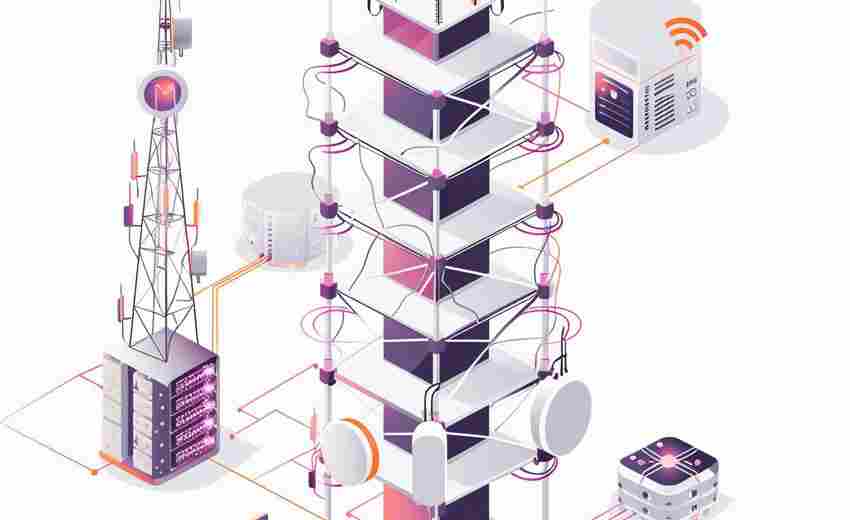

网络层面的监控同样不可忽视,TCP重传率超过2%可能预示网络拥塞,某跨国企业通过Smokeping工具发现区域间专线抖动导致的HTTP超时。对于微服务架构,分布式追踪系统如Jaeger能绘制服务调用拓扑图,某次全局性延迟升高的故障中,正是通过该工具定位到某个边缘节点的异常。

代码调试技术演进

在本地开发环境,Chrome DevTools的Memory面板曾帮助某团队发现未释放的DOM节点导致的渐进式内存增长。对于生产环境,动态调试工具如Node.js的inspector模块,允许开发者在不停机条件下捕获变量快照,某电商系统通过此技术修复了优惠券计算中的浮点精度错误。

调试过程中需警惕"海森堡效应"——观测行为本身改变系统状态。某次使用strace追踪系统调用时,因工具自身资源消耗导致的问题复现困难,最终改用静态代码分析工具Coverity发现竞态条件漏洞。版本控制系统与错误追踪的联动也至关重要,Git bisect命令曾帮助团队在300次提交中快速定位到引发内存溢出的特定代码变更。

网络链路逐层验证

DNS解析故障常以隐蔽方式影响服务,某新闻客户端使用dig命令发现DNS查询TTL设置过短导致解析延迟突增。使用traceroute进行路由追踪时,某视频网站发现某ISP节点的异常丢包,通过部署Anycast网络实现智能路由规避。对于HTTPS证书问题,openssl s_client命令可详细校验握手过程,某次跨区域访问故障正是通过该工具发现中间人攻击导致的证书链断裂。

CDN配置错误引发的缓存污染也屡见不鲜。某门户网站首页样式异常,最终查明是CDN边缘节点未正确遵循Cache-Control头部,通过强制刷新CDN缓存并设置验证头解决问题。防火墙规则的影响更需谨慎,某API服务突然中断,通过iptables日志分析发现新部署的安全策略误拦截了合法请求。