在数字营销领域,SEO软件的真实效果与数据准确性直接关系着优化策略的成败。随着市场工具种类繁杂,部分工具存在数据滞后、算法偏差或虚标指标等问题,如何科学验证其有效性,成为从业者规避决策风险的核心能力。

数据来源的可靠性验证

验证工具数据真实性的首要环节是追溯原始数据源。以Google Search Console(GSC)为例,作为官方数据接口,其收录量、点击率等指标具有最高权威性。第三方工具如Ahrefs、SEMrush的网页索引数据,需与GSC后台的实际收录页面进行交叉比对,误差率超过15%则需警惕数据采集缺陷。

部分工具会采用混合数据源提升覆盖广度,例如将爬虫抓取与API接口结合。此时需关注其数据更新频率标注,对于声称实时更新的工具,可通过设置特定测试页面(如临时屏蔽页面、新增外链),观察工具捕捉变化的响应速度。某案例测试显示,同个外链建设动作在不同工具中的反馈延迟差异达72小时,直接影响策略调整时效。

核心指标的交叉验证

关键词排名监测需建立多工具对照体系。以某医疗网站“种植牙”关键词为例,Google Search Console显示自然点击率12.3%,而某SEO工具报告排名第8位却无实际点击量,经排查发现其未过滤地域性要求差异。此类情况需结合GA4的地理流量报告进行三维验证,排除工具的地理定位偏差。

流量质量评估要穿透表层数据。某电商平台工具显示自然流量月增30%,但GA4热图分析发现新增流量集中在凌晨时段且跳出率92%,进一步追踪发现源自某爬虫云服务器集群。这说明单纯依赖工具的总量指标易产生误判,必须结合用户行为数据进行质量过滤。

算法模型的压力测试

对工具预测功能进行极端场景模拟。选取10组历史数据已知的关键词(如“疫情旅游政策”),输入工具进行难度预测,对比其预估排名周期与实际优化耗时的吻合度。某工具对长尾词预测3周可达前20名,实际优化中因内容质量不足耗时9周,暴露其算法未纳入EEAT(经验、专业、权威、可信)维度评估的缺陷。

外链分析工具需验证垃圾链接识别能力。手动建设5组特征外链:①高DA低相关性,②低DA高相关性,③论坛签名链接,④新闻稿dofollow链接,⑤PBN链接。观察工具对优质外链的识别准确率,某工具将④类链接误判为低质量链接,反映出其权重算法存在结构性偏差。

长期趋势的追踪验证

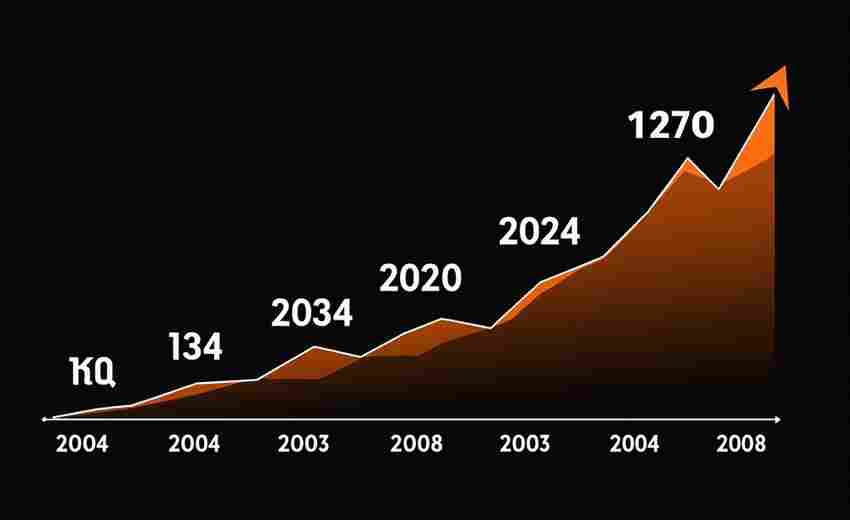

建立12个月以上的数据追踪模型。某教育机构持续记录SEMrush的流量预测数据,发现其Q2季度预测误差率达38%,主要源于未考虑暑假季节性波动。此类长期跟踪能揭示工具算法的适应性短板,特别是对行业周期、政策调整等外部变量的响应能力。

对比工具数据与业务指标的关联性。某B2B企业通过Spearman相关系数分析,发现某工具的关键词排名提升与询盘量相关系数仅0.32,而点击率与转化率的相关系数达0.79。这种量化验证能筛选出真正影响业务的核心指标,避免陷入虚假数据繁荣。

技术参数的深度解析

页面速度监测需穿透工具表层评分。某工具给出移动端速度评分85分,但通过Chrome DevTools的LCP(最大内容绘制)指标实测发现首屏加载达4.2秒。深入解析发现工具未计算第三方JS执行阻塞,这种技术盲区验证需配合Lighthouse等专业检测工具。

索引诊断功能要验证爬虫模拟真实性。在某工具显示“完美抓取”的页面上,通过日志分析发现Googlebot实际访问频次仅为工具报告的1/3。建立服务器日志与工具报告的访问频次对比表,能有效识别伪爬虫数据。